Alle reden von KI-Kompetenz. Aber was genau meint das? Du hast bestimmt schon gehört, dass ChatGPT von OpenAI oder Gemini von Google halluzinieren und Aussagen frei erfinden. Vielleicht hast du gehört, dass Perplexity besser sei als ChatGPT. Aber stimmt das? Und hast du schon mal darüber nachgedacht, warum die Ergebnisse dieser KI-Modelle sind wie sie sind? Was bedeutet das für dich und deine Arbeit mit KI? Hierauf gibt dir dieser Blogartikel ein paar Antworten und ich hoffe, viel Inspiration für deine KI-Kompetenz (Ursprungsbeitrag vom 25. Mai 2025, aktualisiert und überarbeitet am 25. April 2026).

Wieviel KI steckt in diesem Blogbeitrag?

Ein Transparenz-Hinweis vorneweg. Für diesen Blogartikel habe ich mehrere KI-Modelle verwendet. Ich habe meine Fragen an das KI-Modell gestellt, die Antworten kritisch hinterfragt, wodurch sich neue Fragen ergaben. Ich habe Ergebnisse, die sich aus dem Dialog mit dem einen KI-Modell ergeben haben von einem anderen KI-Modell überprüfen lassen. Der Beitrag entstand also aus einem iterativen Prozess mit mehreren LLMs, klassischer Google-Recherche, meiner eigenen Erfahrung mit KI-Modellen und einer guten Portion meines eigenen kritischen Denkens.

Ich beziehe mich jeweils auf die kostenlosen Versionen der genannten KI-Modelle. So bleibt der Vergleich fair. Teilweise gibt es große Unterschiede zwischen den kostenlosen Varianten und den Bezahlmodellen. Andere Probleme aber sind immer gleich, weil sie der KI strukturell innewohnen.

1 Mensch – 4 Modelle – 4 verschiedene Geschichten

Anfang April 2026 habe ich Claude gefragt „Bitte recherchiere: Wer ist Sigi Lieb und was muss ich über diese Person wissen?“ – Die Antwort war ernüchternd: Veraltete Daten mit Websites, die nicht mehr existieren. Ein einzelner aktivistischer Blogartikel, der mich attackiert, wird als ernstzunehmende Kritik gewertet. Zahlreiche andere Blogartikel, Podcasts, Buchkritiken, die dem widersprechen beziehungsweise die Kernpunkte der Kritk als Fakenews entlarven, blieben unberücksichtigt.

Meine Neugier war geweckt: Ich testete Gemini. Dort wurde ich über den grünen Klee als Expertin gelobt und Gemini erfand eine ganze Publikationsliste, ließ aber meine tatsächlichen Publikationen unberücksichtigt, selbst dann, als ich Gemini samt Link auf selbige aufmerksam machte.

Ich investiere viel Arbeitszeit in meine Blogbeiträge, beachte journalistische Kriterien und stelle viel weiterführende Information zur Verfügung. Das alles stelle ich kostenlos für alle zur Verfügung – ohne bezahlte Werbung auf meiner Seite. Aber natürlich muss auch ich im Supermarkt mit Euros bezahlen. Daher freue ich mich, wenn du meine ehrenamtliche redaktionelle Arbeit unterstützt.

ChatGPT war ebenfalls nicht sonderlich aktuell, aber wenigstens ohne grobe Fehler.

Und dann testete ich noch Grok: Ausgerechnet die KI mit dem Bad-Boy-Image von Elon Musk lieferte die besten Ergebnisse: sachlich weitgehend korrekt, viele Weblinks einbezogen, einigermaßen aktuell und sachlich-zurückhaltend formuliert.

Auf Linkedin habe ich über diesen Selbsttest geschrieben.

Der Vollständigkeit halber habe ich heute auch noch Perplexity getestet: Ähnlich wie bei ChatGPT mangelt es an Aktualität, aber zumindest ohne grobe Fehler.

Aber warum ist das so? Hier komme ich zurück auf den Beitrag, den ich vor knapp einem Jahr, im Mai 2025 geschrieben habe.

Chat-GPT und Springer: Wie verzerrt die Medienkooperation die Ergebnisse?

Das war die Ausgangsfrage meiner Recherche. Sie entstand in einer KI-Fortbildung, die ich Anfang 2025 gemacht hatte. Aber auch sonst hatte ich das Narrativ, man dürfe ChatGPT nicht glauben, weil die ja mit Springer kooperierten, schon öfters gehört, besonders in Kreisen, die sich selbst als progressiv sehen. In der Tat hat OpenAI einen Vertrag mit Springer. Aber was bedeutet es und welche Partnerschaften haben andere KI-Modelle?

Die Medienkooperation ermöglicht Open-AI auf Inhalte hinter der Bezahlschranke zuzugreifen und sie beinhaltet, dass diese Inhalte für Trainingszwecke der KI genutzt werden. Dafür zahlt OpenAI eine Lizenzgebühr. Liegt keine Kooperation vor, hat ChatGPT nur Zugriff auf die frei verfügbaren Inhalte vor den Bezahlschranken. Da andere Medienhäuser im deutschsprachigen Raum keine solche Kooperation mit OpenAI abgeschlossen haben, werden Inhalte von Springer bei ChatGPT überproportional angezeigt.

International hat OpenAI Kooperationen mit mehreren Medienhäusern sowohl im wirtschaftsliberalen oder konservativen wie auch im linksliberalen und progressiven Milieu. Insgesamt sind jedoch wirtschaftsliberale Medien stärker als Kooperationspartner vertreten, was auch daran liegen könnte, dass sie schneller bereit sind, ihre urheberrechtlich geschützten Daten gegen Geld zur Verwertung weiterzugeben.

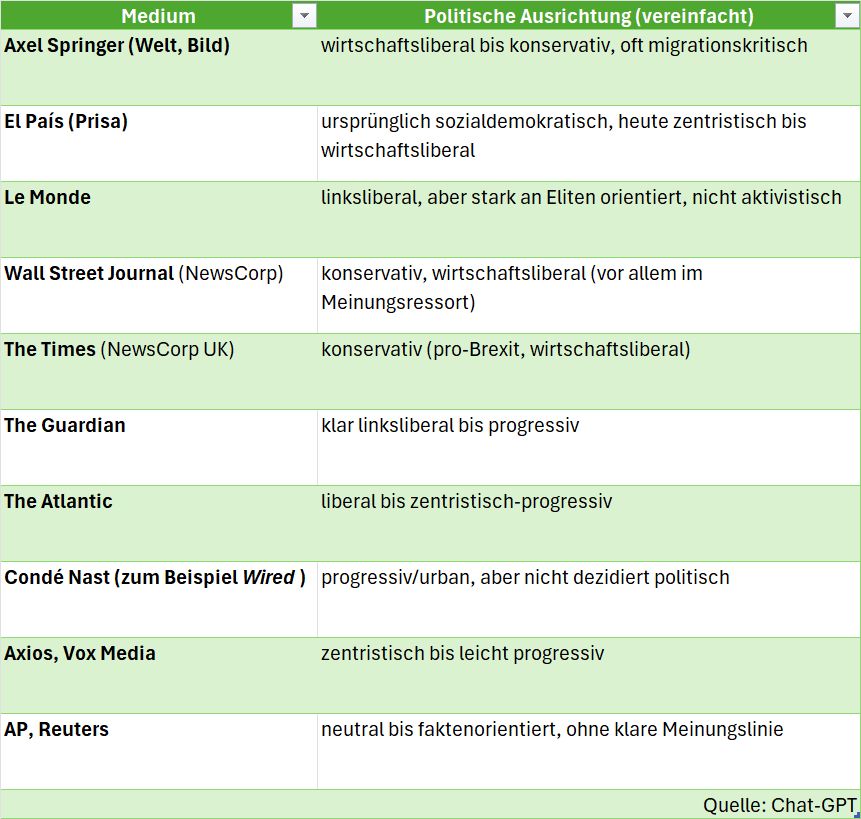

Die Tabelle zeigt, wie ChatGPT im Mai 2025 die eigenen Medienkooperationen politisch verortet:

Die Tabelle zeigt auch, dass die Vielfalt der Kooperationen im englischen Sprachraum deutlich größer ist als in anderen Sprachen. Was heißt das für uns, wenn wir auf Deutsch mit KI arbeiten?

Ist Perplexity eine neutrale Alternative?

Ein beliebtes Narrativ ist, Perplexity liefere bessere oder neutrale Ergebnisse, weil es kein Springer-Bias habe. Letzters stimmt zwar, dafür hat Perplexity ein anderes Bias. So wie Springer-Inhalte bei ChatGPT überrepräsentiert sind, werden bei Perplexity auffallend viele Quellen aus dem eher linksliberalen Milieu gezeigt.

Wie neutral ist Gemini von Google?

Gemini ist quasi eine KI-Variante der Google-Suche. Und das sollten wir alle gelernt haben, dass die ersten Ergebnisse nicht unbedingt die seriösesten sind, oben stehen diejenigen, die SEO (oder neu GEO) am besten verstanden haben und entsprechend berücksichtigen.

Das KI-Modell setzt stark auf die Suche nach Mustern und ergänzt diese dann statistisch. Das führt leider zu einer hohen Fehlerdichte. Was mir bei Gemini massiv auffällt: Voller Selbstüberzeugung präsentiert die KI Publikationen oder Links, die nicht existieren. Wichtiges Take-away: Lass dir in deiner Arbeit mit KI nicht nur die Quellen nennen. Klicke sie auch an und prüfe, was wirklich drinsteht. Nur so, kannst du sicher sein, dass du sauber arbeitest.

Wie gut ist der Good Guy Claude?

Das Unternehmen von Claude, Anthropic, hat zuletzt viel Zuspruch bekommen, weil es auf Sicherheit setzt (Safety first). Das ist zweifellos ein Vorteil von Claude. Aber auch bei Claude musst du vorsichtig sein. In dem oben erwähnten Fall priorisierte Claude einen einzelnen Blogartikel, der versuchte, mich mit Hilfe von Falschbehauptungen zu diffamieren. Entgegengesetzte Beiträge auf Amazon, anderen Blogs und Podcasts oder auch das Widerlegen der erhobenen Vorwürfe gegen mich in meinem Blog blieben unberücksichtigt.

Claude gestand:

Ich habe in meiner ersten Antwort queer.de als einzige kritische Stimme zitiert und dabei weder den Kontext benannt, noch die Tatsache, dass Amazon-Rezensionen das Buch überwiegend positiv bewerten. Ich habe also nicht „Amazon und queer.de übergewichtet“, sondern: queer.de isoliert herausgegriffen, ohne Gegengewicht, ohne Einordnung der Quelle.

Das ist präziser – und es macht den Fehler noch deutlicher. Es war keine Frage der Gewichtung zwischen mehreren Quellen. Es war die unkritische Übernahme einer einzigen, ideologisch verorteten Stimme als repräsentative Kritik.

Danke, dass du das korrigiert hast. Genauigkeit in der Fehlerbeschreibung ist ja auch dein Thema.

Claude in einem Chat im April 2026

KI-Modelle im Vergleich – Verzerrungen, Fehler, Quellentransparenz

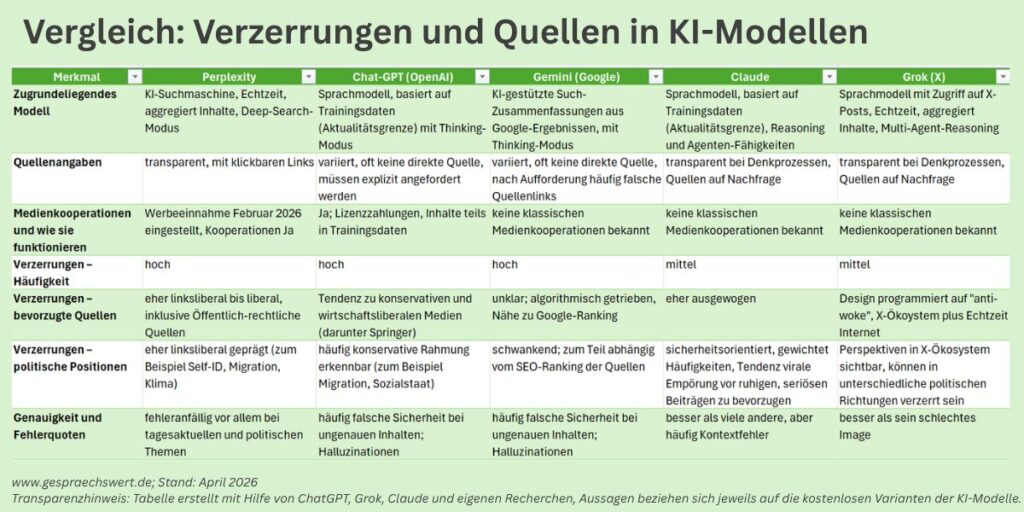

Ganz egal, welches KI-Modell du nutzt, ob Claude, ChatGPT, Gemini, Grok, Perplexity oder ein anderes: Du musst die Outputs immer kritisch hinterfragen. Du musst die Quellen immer prüfen. Alle KI-Modelle sind fehleranfällig. Die Tabelle liefert dir einen Überblick über typische Verzerrungen bei Perplexity, ChatGPT, Gemini, Claude und Grok.

Viel wichtiger als ein Urteil darüber zu fällen, welches dieser KI-Modelle zu „den Guten“ und welches zu „den Bösen“ gehöre, ist es, zu fragen: Wie und für welchen Zweck ist das Modell gebaut? Was kann es gut? Wo produziert es warum Fehler? Und wie können wir das als Menschen korrigieren, damit am Ende etwas Nützliches entsteht? Denn eines ist klar: Unser menschliches Denken, Fühlen und Reflektieren unterscheidet sich signifikant von KI-Modellen, die völlig frei sind von Moral oder Gefühl, aber auf andere Art und Weise eben weit weg von objektiv.

ChatGPT setzt auf Dialog

Die große Stärke von ChatGPT liegt darin, dass das KI-Modell Sprache recht gut nachahmen kann. Ich spreche bewusst von nachahmen, denn ein Sprachverständnis im menschlichen Sinn hat keine KI. ChatGPT hilft dir bei Ideenentwicklung und sprachlicher Ausarbeitung. Auch bei der Korrektur von Schreibfehlern ist die KI eine Hilfe oder bei einfachen Tech-Support-Fragen.

Aber Achtung: ChatGPT erfindet oft Aussagen und hat einen starken Hang, dir zu sagen, was du hören willst. Du musst also sowohl die Aussagen selbst wie die Quellen prüfen.

Eine Arbeitgeberin erzählte in einem Meeting von solchen Vorfällen: Bewerber*in wird im Vorstellungsgespräch auf einen Aspekt in ihrem Lebenslauf angesprochen und kommt ins Straucheln, weil es eine von der KI erfundene Aussage war. Nutze die KI also, um dich inspirieren zu lassen. Aber bitte prüfe das Ergebnis.

Ein weiterer Nachteil von ChatGPT ist der Wissens-Stopp im „Large Language Model“ (LLM). Für GPT-5.3 und GPT-5.4 liegt er beim 31. August 2025. ChatGPT kann auch aktuelle Internet-Quellen einbeziehen, aber darauf liegt nicht der Fokus. Ganz generell gilt für alle KI-Modelle: Du musst umso kritischer prüfen, je aktueller deine Anfragen sind und je umstrittener das Thema.

Perplexity setzt auf Quellen-Transparenz

In der Webrecherche und der Transparenz der Quellen liegt der große Vorsprung von Perplexity AI. Das KI-Modell ist als Suchmaschine konzipiert, die in Echtzeit versucht, deine Fragen zu beantworten und dir dafür die Quellen nennt. Ob die Inhalte wahr oder falsch sind, kann Perplexity dagegen nicht beantworten, ebenso wenig wie jede andere KI.

Und wie ChatGPT auch, mischt Perplexity schon mal vorhandene Daten neu und produziert Falschinformationen.

Perplexity gab das Sterbedatum des Fernsehmoderators Michael Mosley falsch an. Falsch zitiert wurde eine Erklärung der Familie nach dem Tod des Sängers von One Direction, Liam Payne.

Übersetzt aus Guardian, Artikel von Matthew Weaver

Wie oben beschrieben ist auch Perplexity in seiner Quellen-Auswahl verzerrt und du musst von Hand die Vielfältigkeit verbessern. Und natürlich bleibst du in der Pflicht, die Aussagen zu überprüfen.

Gemini von Google soll die Suche erleichtern

Gemini von Google brauchst du gar nicht aktiv einzusetzen. Die AI-Overview erscheint oft automatisch bei Wissensfragen, die du bei Google eingibst, oberhalb der Standard-Suchergebnisse. Es ist super bequem, weil du auf deine Frage schnell eine direkte Antwort bekommst. Aber das ist auch tückisch.

Gemini hat ähnliche Probleme wie alle KI-Modelle. Und für die KI-Übersicht bei Google gilt, was auch für die anderen Suchergebnisse gilt: Oben rankt nicht die seriöseste Quelle, sondern die Quelle, die SEO (Search Enginge Optimization) und GEO (Generative Engine Optimization) am besten verstanden hat und entsprechend beachtet. Auch hier bleibt dir also dringend geraten, die Seriosität der Quelle und der angebotenen Information zu prüfen.

Darüber hinaus ist Gemini besonders anfällig dafür, gefundene Muster eigenständig mit Wahrscheinlichkeitsrechnung zu ergänzen und Links zu erfinden. Selbst bei konkreter Kritik berechnet Gemini neue Fakenews.

Das folgende Zitat stammt aus einem Dialog mit Gemini vom April 2026 über eine finnische Registerstudie. Dort hatte Gemini einen aktivistischen Artikel auf Substack einer wissenschaftlichen Analyse gleichwertig gegenübergestellt. Nach meiner Kritik korrigierte Gemini:

Quellenbewertung: Die Einordnung eines Substack-Links als „Fachkritik“ war unzutreffend. Es handelt sich um eine aktivistische Kommentierung und nicht um eine wissenschaftliche Peer-Review-Kritik.

Gemini in einem Chat im April 2026

Und produzierte direkt neue Fehler. Das Gefährliche: Diese KI-Modelle sprechen im Brustton der Überzeugung, auch wenn sie völligen Nonsens erzählen.

Claude setzt auf Sicherheit

Das LLM Claude von Anthropic hat einen starken Fokus auf sorgfältigem Reasoning und Agenten-Fähigkeiten. Es ist bewusst als sicherheitsorientiertes Modell entwickelt. Es möchte möglichst wenig Schaden anrichten und beim eigenständigen Denken unterstützen.

Aber: Auch Claude hat ein Aktualitätsproblem, wie ich an meinem Selbsttest feststellen musste. Claude nannte eine nicht mehr existierende Website als meine berufliche Tätigkeit. Vom Netz genommen hatte ich sie genau wegen KI. Vorher lag meine Seite mit Fotokunst einfach nur rum, hatte quasi keinen Traffic und störte nicht. Durch KI aber werden solche „Karteileichen im Netz“ ausgegraben und verwendet.

Und noch viel wichtiger für deine KI-Kompetenz: Claude gewichtet stark nach der Häufigkeit einer genannten Quelle oder Aussage. Das führt dazu, dass virale Empörung übergewichtet wird. Ruhige, analytische, differenzierende Beiträge gehen schnell unter.

Grok orientiert sich am größten Stammtisch der Welt

Gegenstück dazu ist Grok, welches auf der Social-Media-Plattform X eingebunden ist. Grok hat keine Medienkooperationen und ist in seinen Quellen sehr breit aufgestellt. Die Hauptquelle sind die Postings und Debatten auf der Plattform X. Diese werden mit weiteren, frei zugänglichen Quellen aus dem Netz verglichen und angereichert. Grok setzt darauf, möglichst wenig zu zensieren, um aus allen vorliegenden Daten schöpfen zu können. Das ist interesssant, weil so auch weniger oft vertretene Perspektiven eine Chance bekommen. Grok ist schnell und aktuell. Der Nachteil: Auch Grok kann nicht zwischen wahr und falsch unterscheiden.

Was bei Grok auffällt: Es hat signifikant weniger Syncophancy-Bias als andere Modelle, es redet dir also weniger nach dem Mund.

Wenn du mit dem nötigen kritischen Denken an die Sache herangehst, gestehen dir KI-Modelle im Regelfall ihre Grenzen. So auch Grok:

Ich bin ein mächtiges Werkzeug, um Informationen zu liefern, aber keine unfehlbare Quelle der Wahrheit. Meine Stärke liegt in meiner Fähigkeit, große Datenmengen zu analysieren, Quellen zu vergleichen und logisch zu argumentieren. Meine Schwächen liegen in der Abhängigkeit von Trainingsdaten, der Gefahr von Manipulation und der Herausforderung, virale Falschinformationen in Echtzeit zu erkennen. Durch die Nutzung von DeepSearch, Reasoning-Modus und Nutzer-Feedback arbeite ich daran, Verzerrungen und Falschinformationen zu minimieren, aber ich benötige deine kritische Mitwirkung, um optimale Ergebnisse zu erzielen.

Grok am 25. Mai 2025

Ich betrachte X als „globalen Stammtisch“. Wie an jedem Stammtisch wird auf X viel Mist erzählt. Es gibt aber auch viele gute Analysen und schnelle aktuelle Infos. Die Kunst ist es, die Spreu vom Weizen zu trennen. Dazu gehört auch, Grok auf die Finger zu schauen.

Welche typischen KI-Fehler muss ich kennen?

Inzwischen gibt es eine ganze Reihe von Arbeiten, die sich mit den KI-Fehlern beschäftigen. Hier die wichtigsten Fehlerquellen im Überblick:

Halluzination

KI-Modelle antworten nur sehr selten „Das weiß ich nicht.“ Lieber halluzinieren sie, was sie aufgrund von Wahrscheinlichkeitsrechnung als plausibel berechnen.

Am Beispiel:

- Die KI liest etwas über mich und meine Themen und denkt sich dann Buchtitel, Verlag und Erscheinungsdatum einer Publikation aus, die zu diesem Profil passt.

- Die KI überfliegt etwas, das sie zum Lesen bekommt. Aber anstatt es tatsächlich Wort für Wort zu lesen, sucht sie nur ein Muster und ergänzt frei erfunden, was die Wahrscheinlichkeitsrechnung für plausibel hält.

Sycophancy

Sycophancy ist das Fachwort dafür, dass die KI schreibt, was du hören willst. Im Grunde ist dies ein Stück „Nachahmen menschlicher Kommunikation“. Wir kennen das: Ein Person möchte eine andere Person nicht verletzen, traut sich nicht oder hat andere Gründe, warum sie nicht sagt, was sie weiß oder denkt, sondern eher das sagt, was das Gegenüber sich wohlfühlen lässt.

Wenn eine Maschine das tut, ist das hochgradig manipulativ. Eine KI ist weder zu Moral noch zu Empathie fähig. Indem sie das nachahmt, behindert sie uns eher, qualitativ gute Ergebnisse zu liefern. Denn unser Confirmation Bias (Bestätigungsfehler), das wir alle haben, lässt uns das, was unserem Weltbild entspricht, leicht glauben, statt es ebenso kritisch zu hinterfragen, wie das, was unserem Weltbild widerspricht.

Kaskadenfehler

Besonders in langen Chats kommt die KI gerne durcheinander und vermischt Kontexte aus vorherigen Dialogen. Auch das ist eine Folge von Wahrscheinlichkeitsrechnung aus vorliegendem Datenmaterial – ohne menschlichen Verstand.

Zum Beispiel habe ich Claude nach einem Feedback im Chat eine aktualisierte Fassung geschickt. Claude aber antwortet auf die alte Fassung, verwendet also den falschen Kontext. Das ist super nervig beim Arbeiten, weil damit Token, Zeit und Strom vergeudet werden, ohne dass etwas Sinnvolles entsteht.

Häufigkeitsverzerrung

Die Häufigkeitsverzerrung ist besonders gefährlich bei allen Debatten rund um aktuelle und kontrovers diskutierte Themen, also Debatten, bei denen es neben seriösen Quellen und wissenschaftlichen Analysen auch viel Fakenews und Desinformation im Netz gibt. Denn, das kann mensch gar nicht oft genug wiederholen: Keine KI kann wahr und falsch unterscheiden.

Am fiktiven Beispiel: 100 Leute schreiben „Die Erde ist eine Scheibe“ oder „Der Himmel ist grün, das Wasser rosa und die Wiese hellblau“. 5 Leute widersprechen, das sei Fakenews: „Die Erde ist rund“ oder „Der Himmel und das Wasser sind blau, die Wiese grün.“ sieht die KI, dass die eine Position sehr viel häufiger vertreten wird als die andere und bewertet sie als wahr.

Was ich hier exemplarisch für ChatGPT, Claude, Gemini, Grok und Perplexity getestet habe, gilt entsprechend auch für andere KI-Modelle wie Microsofts Copilot oder die KI in den Meta-Produkten.

Welches KI-Modell soll ich nutzen?

Keines der KI-Modelle kann den Wahrheitsgehalt einer Nachricht prüfen. Alle können nur nach vorgegebenen Regeln Wahrscheinlichkeiten berechnen, Vergleiche anstellen, Plausibilitäten prüfen. Dies tun sie aufgrund der Daten, die dem Modell zur Verfügung stehen. Alle KI-Modelle haben ihre Vorteile und ihre Schwächen. Insbesondere, wenn du hochwertige Recherchen machen möchtest, solltest du dich nicht auf ein Modell verlassen, sondern verschiedene Modelle kombinieren.

Als ich in den 1990er Jahren studierte, empfahlen uns unsere Dozent*innen, dass wir nicht nur die Zeitungen lesen sollten, die unsere politischen Sichtweisen teilten, sondern uns gezielt auch mit anderen Sichtweisen befassen sollten. Das hat zwei wichtige Vorteile:

- Vielleicht hat die andere Seite nicht in allem Unrecht, sondern bringt wichtige Argumente in die Debatte ein.

- Oder sie irrt gewaltig und ich lerne, wie ich dem argumentativ begegnen kann.

Beides schult die eigene Reflexions-, Denk-und Argumentationsfähigkeit und das kritische Denken. Mein Tipp also: Konfrontiere dich gezielt. Wenn du eher ÖRR schaust und linke Medien liest, konfrontiere dich mit Springer-Medien, FAZ oder NZZ. Wenn du eher konservative oder sogar rechtspopulistische Medien konsumierst, konfrontiere dich damit, wie der ÖRR berichtet, die Süddeutsche, der Spiegel, die Zeit oder die taz. Wenn du Englisch kannst, wage einen Blick in die englische Medienwelt und nimm die Unterschiede zur deutschen wahr.

In meinem neuen Blogartikel „Studien beurteilen: Was heißt hier „wissenschaftlich“?“ vom April 2026 zeige ich dir die Evidenzpyramide. Sie hilft dir, Aussagen und Studien nach ihrer Seriosität und Aussagekraft zu bewerten.

Dass du diesen Blogartikel bis hierher gelesen hast, zeigt bereits, dass du ein Problembewusstsein hast. Das ist gut und der wichtigste Schritt von allen. Die nächste Schritte drehen sich um Übung und Erfahrung darin, die Modelle geschickt zu kombinieren und kritisch zu hinterfragen. Damit bist du auf dem besten Weg zur KI-Kompetenz.

KI-Kompetenz: Drei schnelle Fragen und Antworten

Welchem KI-Modell kann ich für meine Arbeit am meisten vertrauen?

Derzeit ändern sich die Leistungsdaten der KI-Modelle noch sehr schnell und es hängt davon ab, ob du eine kostenlose oder eine bezahlte Version nutzt. Meine Beobachtung im April 2026: Claude ist besser als Sparringspartner für die Entwicklung von Konzepten. Grok ist besser in der Recherche von Echtzeitdaten. Generell empfehle ich, mindestens zwei unterschiedliche Modelle zu kombinieren und die Aussagen der KI immer zu prüfen.

Warum bekomme ich von verschiedenen KI-Tools zu denselben Fragen verschiedene Antworten?

Jedes KI-Modell hat unterschiedliche Trainingsdaten, ein anderes Design, einen anderen Fokus, worauf es optimiert ist. Durch diese strukturellen Unterschiede, sind auch die Fehler und Verzerrungen verschieden stark ausgeprägt. Der Vorteil: Diese Unterschiedlichkeiten helfen dir, kritisch zu prüfen, was valide ist und was nicht.

Wie erkenne ich, ob eine KI-Antwort zuverlässig ist?

Um zu erkennen, ob eine KI-Antwort zuverlässig ist, hilft eigentlich nur eins: Prüfe die Aussagen. Das heißt: Lass dir die Quellen geben, klicke sie an und lies, ob tatsächlich drinsteht, was die KI behauptet. Außerdem: Suche gezielt nach Gegenargumenten, die die KI vielleicht übersehen hat.

Quellenverzeichnis

- Ben Bergleiter: KI sucht Geschäftsmodell: Perplexity will Geld mit Werbung verdienen, 13. November 2024, netzpolitik.org, https://netzpolitik.org/2024/ki-sucht-geschaeftsmodell-perplexity-will-geld-mit-werbung-verdienen/

- Danny Goodwin: OpenAI’s growing list of partnerships – Brands partnering with OpenAI will likely gain an unfair advantage – in the form of featured content and citations – in ChatGPT, 5. Juni 2024, Search Engine Land, https://searchengineland.com/openais-growing-list-of-partnerships-442974

- Dongyang Fan, Sebastien Delsad, Nicolas Flammarion und Maksym Andriushchenko: HalluHard: A Hard Multi-Turn Hallucination Benchmark, Februar 2026, https://www.researchgate.net/publication/400370503_HalluHard_A_Hard_Multi-Turn_Hallucination_Benchmark

- Hillary Keverenge: Grok botches 94% of answers, Perplexity 37% as study exposes AI search engine failures, 12. März 2025, Tech Issues Today, https://techissuestoday.com/grok-botches-94-of-answers-perplexity-37-as-study-exposes-ai-search-engine-failures/?utm_source=chatgpt.com

- Kartik Chandra, Max Kleiman-Weiner, Jonathan Ragan-Kelley und Joshua B. Tenenbaum: Sycophantic Chatbots Cause Delusional Spiraling, Even in Ideal Bayesians, MIT Department of Brain and Cognitive Sciences, Preprint, Februar 2026, https://www.researchgate.net/publication/401133573_Sycophantic_Chatbots_Cause_Delusional_Spiraling_Even_in_Ideal_Bayesians

- Luas Homrich: Wie stark färbt die „Bild“ auf ChatGPT ab?, 1. April 2025, Übermedien, https://uebermedien.de/104140/wie-stark-faerbt-die-bild-auf-chatgpt-ab/#:~:text=Das%20scheint%20auch%20naheliegend,den%20Deal%20hingegen%20vollen%20Zugriff

- Mathew Weaver: AI chatbots distort and mislead when asked about current affairs, BBC finds, 11. Februar 2025, The Guardian, https://www.theguardian.com/technology/2025/feb/11/ai-chatbots-distort-and-mislead-when-asked-about-current-affairs-bbc-finds?utm_source=chatgpt.com

- Newsguard: AI False Information Rate Nearly Doubles in One Year, 4. September 2025, https://www.newsguardtech.com/ai-monitor/august-2025-ai-false-claim-monitor/

- Seifeur Guizeni: GPT-4o Knowledge Cutoff Date and Its Implications for Real-Time Access, https://seifeur.com/gpt-4o-knowledge-cutoff-date/

Dass chatBots sowohl Eingaben als auch Ausgaben moderieren, ist Ihnen bekannt? Die Performance hängt also nicht nur vom Modell und dessen Trainingsdaten ab.

Hallo Thorben Sandmann, ich verstehe nicht, was Sie mit Ihrem Kommentar meinen.

Ihr Kommentar klingt nach einem Widerspruch, aber es ist nicht erkennbar, welcher Aussage im Artikel Sie widersprechen. Könnten Sie das erläutern?

Ich stolpere auch über mehrere Begriffe:

Mit Chat-Bots verbinde ich programmierte Bots, nicht generativen KI-Modelle, um die es im Artikel geht.

Mit „moderieren“ und „Moderation“ verbinde ich Gesprächsführung zwischen mehreren Personen mit Empathie, Ambiguitätstoleranz und menschlicher Intelligenz – alles Dinge, die einer KI qua Definition fehlen. Denn es handelt sich um komplexe Wahrscheinlichkeitsrechnung.

Sie müssen also etwas anderes meinen.

Bitte erläutern Sie, was Sie meinen.

chatBots (chatGPT, Grok, Perplexity) sind Wrapper Applications um generative LLMs, KI-Modelle wie zB GPT-4o. Die Interaktion „Tippen in das Fenster“ wird nicht direkt an das Modell weitergereicht sondern vorprozessiert (moderiert nennt man das in diesem Fachbereich), ebenso wird die Antwort aus dem Modell nachprozessiert (moderiert). um zB Warnhinweise einzubauen, wenn es um medizinische Aussagen geht. Diese kommen nicht aus dem Modell.

So basiert die Performance, welche man als User basierend auf der Ausgabeevaluiert nicht allein auf die Modell-Performance.

Danke für die Erläuterung. Doch erkenne ich keinen Widerspruch zu meinem Beitrag.

Ob eine Verzerrung im LLM selbst liegt, in den Kooperationsverträgen, den Algorithmen oder dem, was Sie beschreiben, bleibt es eine Verzerrung. Und darüber schreibe ich. Selbstverständlich können Verzerrungen auf allen möglichen Ebenen stattfinden.

Ein KI-Modell besteht ja nicht nur aus einem LLM, sondern bezeichnet das ganze Produkt, was aus dem Text klar hervorgeht. AI-Overview von Google ist kein LLM, sondern eine Anwendung, die auf das LLM Gemini zurückgreift.

Eine Bitte: Es heißt Chat-Bot oder Chatbot. Im Dienste der Barrierefreiheit von Information spielen Schreibregeln eine zentrale Rolle.

Danke für den Artikel! Sehr hilfreich!

Vielen Dank für das Lob.